Claude Sonnet 4.6 vs Gemini 3 Pro vs GPT-5.2 : Lequel code (et écrit) vraiment mieux en 2026 ?

Février 2026. Trois IA. Un seul gagnant — mais pas celui que vous croyez.

Je l’ai posé direct sur la table à mes partenaires la semaine dernière : “Si vous deviez garder UN seul outil IA pour coder et rédiger, lequel ce serait ?” Silence. Parce que la vraie réponse, elle n’est pas dans les communiqués de presse. Elle est dans les benchmarks, dans la facture de fin de mois, et dans ce que vous faites concrètement.

J’ai testé les trois. Voici ce que j’ai trouvé — données, friction et tout.

Capture side-by-side Claude.ai / Google Gemini / ChatGPT avec une tâche de code en cours

Ce que vous voulez savoir (réponse directe)

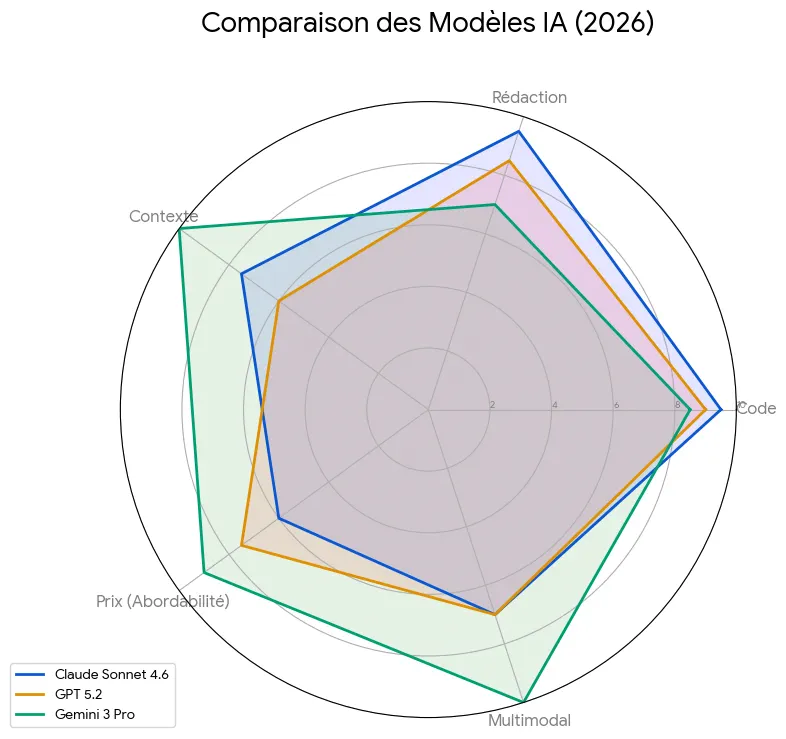

La réponse courte : Claude Sonnet 4.6 domine sur le code complexe et la rédaction longue. Gemini 3 Pro écrase tout le monde sur les grands projets grâce à sa fenêtre d’1M tokens. GPT-5.2 reste le plus polyvalent et le mieux intégré. Votre choix dépend de votre cas d’usage, pas d’un classement universel.

| Critère | Claude Sonnet 4.6 | Gemini 3 Pro | GPT-5.2 |

|---|---|---|---|

| Code (SWE-bench) | 🥇 77,2% | 🥉 73,1% | 🥈 74,9% |

| Rédaction / Docs | 🥇 Naturel, fluide | 🥉 Technique | 🥈 Précis |

| Fenêtre de contexte | 200K (1M bêta) | 1M tokens | 128K |

| Prix (entrée / M tokens) | ~3 $/M | 2 $/M | Variable |

| Multimodal | Texte + Image | Texte, Image, Audio, Vidéo | Texte + Image |

| Meilleur pour | Code long & rédaction | Gros codebases, vidéo | Usage quotidien polyvalent |

Claude Sonnet 4.6 : le nouveau patron du code

Sorti le 15 février 2026 — oui, il y a 48 heures au moment où j’écris ces lignes.

Anthropic a lâché Claude Sonnet 4.6 le 15 février 2026 et c’est une mise à jour substantielle. Ce n’est pas un coup marketing : les chiffres le confirment.

Ce qui change vraiment avec Sonnet 4.6 :

- Score SWE-bench Verified de 77,2% — le meilleur du marché sur les bugs réels

- 94% sur le benchmark “computer use” d’Anthropic (navigation dans des formulaires complexes, tableurs)

- Introduction du paramètre

effort(low / medium / high / max) pour équilibrer vitesse, coût et performance - Fenêtre de 200K tokens (1M tokens en bêta)

- Résultats “Opus-level” à un prix Sonnet

La différence que les devs ont senti concrètement : sur un codebase de 15 000 lignes, Claude Sonnet 4.6 trouve le bug sans qu’on lui signale le fichier concerné. Il navigue. GPT-5.2 demande encore souvent où chercher.

💬 “Sonnet 4.6 est déjà excellent sur les corrections de code complexes, surtout quand la recherche dans de grands codebases est essentielle.” — Anthropic, blog officiel

Pour qui ? Développeurs solo, freelances code, rédacteurs de documentation technique.

Gemini 3 Pro : le géant silencieux

Disponible depuis novembre 2025, déployé pour tous le 11 février 2026.

Google a sorti Gemini 3 Pro le 18 novembre 2025 et son déploiement global vient tout juste d’être complété. C’est la bête de somme des trois.

Ses cartes maîtresses :

- 1 million de tokens de contexte (aucun autre n’approche en usage standard)

- Multimodalité native : texte, image, audio, vidéo

- “Meilleur modèle de vibe coding” selon Google eux-mêmes (je sais c’est facile)

- Score SWE-bench : 73,1% — troisième, mais l’écart est de 4 points seulement

- Prix le plus compétitif parmi les modèles premium : 2 $/M tokens en entrée

La vérité que j’ai apprise : quand vous devez comprendre un codebase entier en contexte, Gemini 3 Pro est dans une catégorie à part. Aucun autre ne fait ça aussi bien. J’ai chargé l’intégralité d’un projet WordPress (thème + plugins maison) et il a identifié un conflit de hooks que j’aurais mis une heure à trouver manuellement.

Par contre — et c’est le revers — pour la rédaction créative ou les articles de blog, il reste le plus “robotique” des trois. Le texte sort technique, propre, mais froid.

Pour qui ? Équipes de développement, architectes logiciels, projets avec de gros fichiers à analyser.

GPT-5.2 : le champion de la polyvalence

Toujours le référent pour l’usage quotidien ?

OpenAI et GPT-5.2 sont dans une position paradoxale : ils ne gagnent plus les benchmarks de code face à Claude, mais ils restent l’outil le plus utilisé au monde avec 800 millions d’utilisateurs hebdomadaires.

Ses points forts réels :

- SWE-bench Verified : 74,9% — solide, deuxième place

- Aider Polyglot : 88% avec le mode reasoning activé (+61 points vs sans reasoning)

- Fenêtre de 400K tokens en entrée (contre 128K pour l’API standard)

- Meilleur pour le JavaScript/TypeScript/React : 90-92% de précision

- Écosystème riche (plugins, intégrations, batch processing)

Le reasoning fait toute la différence sur GPT-5.2. Sans mode “thinking”, les écarts avec Claude se creusent. Avec, il revient dans la course.

Pour qui ? Développeurs full-stack web, équipes déjà intégrées dans l’écosystème OpenAI, professionnels qui alternent code et rédaction quotidiennement.

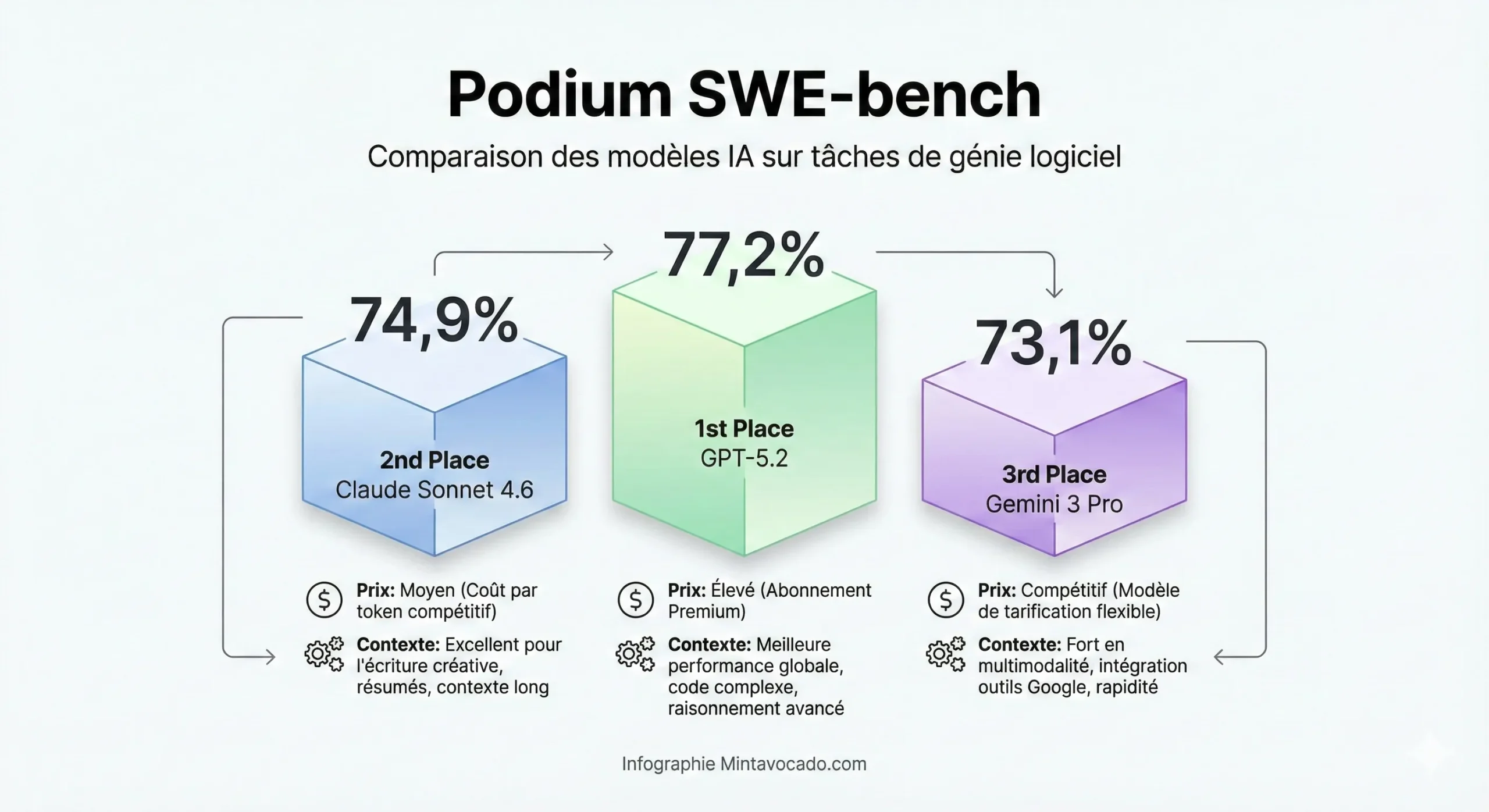

Benchmark code : le classement officiel 2026

SWE-bench Verified — référence industrielle sur des bugs GitHub réels

| Rang | Modèle | SWE-bench | Écart avec #1 |

|---|---|---|---|

| 🥇 1 | Claude Sonnet 4.6 | 77,2% | — |

| 🥈 2 | GPT-5.2 | 74,9% | -2,3 pts |

| 🥉 3 | Gemini 3 Pro | 73,1% | -4,1 pts |

Ce que ces chiffres signifient concrètement : sur 500 bugs réels pris depuis GitHub, Claude en résout 386, GPT-5.2 en résout 374, Gemini 3 Pro en résout 365. La différence entre premier et dernier, c’est 21 bugs sur 500. On n’est plus dans l’ordre de grandeur, on est dans les détails.

Rédaction web et contenu : qui écrit le mieux ?

La question que mes lecteurs m’ont posée en boucle cette semaine. Voici ma réponse terrain.

Classement rédaction (mon test perso, articles 1 000 mots) :

- Claude Sonnet 4.6 🥇 — Le plus naturel. Le texte coule, le ton est humain, les transitions sont fluides. Idéal pour les articles de blog, les newsletters, la rédaction SEO. La documentation aussi

- GPT-5.2 🥈 — Très précis techniquement. Excellent pour les tutoriels, les emails B2B, les contenus structurés. Moins poétique, mais redoutablement efficace

- Gemini 3 Pro 🥉 — Propre, sourcé, mais froid. Son vrai talent en rédaction : synthétiser de longs documents (grâce à ses 1M tokens). Moins bon sur la créativité pure

Mon verdict de praticien : Pour 80% de mes besoins éditoriaux, Claude Sonnet 4.6 produit le meilleur résultat au premier jet. Pour rédiger à partir d’un PDF de 300 pages, Gemini 3 Pro est imbattable.

Le coût réel : ce que vous paierez vraiment

Parce que le meilleur outil, c’est celui qui reste abordable à l’usage.

Voici le coût mensuel simulé pour une équipe de 10 développeurs (20M tokens entrée + 5M tokens sortie/mois) :

| Modèle | Coût mensuel estimé |

|---|---|

| Gemini 3 Flash | 25 $/mois |

| GPT-5.2 (batch) | 52,50 $/mois |

| Gemini 3 Pro | 100 $/mois |

| Claude Sonnet 4.6 | 135 $/mois |

Ce que ça dit : Claude Sonnet 4.6 est le plus cher — et pourtant il domine les benchmarks. C’est le choix “premium justifié”. Gemini 3 Pro offre le meilleur rapport performance/prix des modèles haut de gamme.

Top 3 des cas d’usage : mon verdict final

Voici comment je les utilise personnellement, et comment je conseille de les utiliser :

🥇 1. Claude Sonnet 4.6 — pour coder et rédiger au quotidien

Le nouveau go-to pour les professionnels qui font les deux. Code complexe, articles, documentation. Le paramètre effort permet d’optimiser le coût selon la tâche.

🥈 2. Gemini 3 Pro — pour les grands projets et l’analyse multimodale

Quand votre codebase dépasse ce que les autres peuvent ingérer, ou quand vous avez besoin d’analyser vidéos et audios en plus du texte. Prix imbattable pour ce niveau de capacité.

🥉 3. GPT-5.2 — pour les équipes déjà dans l’écosystème OpenAI

Si vous utilisez déjà ChatGPT, les plugins OpenAI, ou que vous faites du React/TypeScript en production, ne changez pas. GPT-5.2 reste excellent et son score de 74,9% SWE-bench est loin d’être une honte.

Questions fréquentes (PAA & retours terrain)

Claude Sonnet 4.6 est-il vraiment meilleur que Claude Opus 4.6 pour le code ?

Oui, selon Anthropic eux-mêmes. Sonnet 4.6 atteint des performances proches d’Opus à un coût bien inférieur. Pour le code et la rédaction quotidienne, Sonnet 4.6 est désormais le choix recommandé. Opus 4.6 ne vaut le coût que pour des tâches de raisonnement extrêmement complexes.

Gemini 3 Pro peut-il vraiment lire 1 million de tokens ?

Oui, c’est la fenêtre de contexte standard de Gemini 3 Pro. En comparaison, Claude Sonnet 4.6 est à 200K (1M en bêta) et GPT-5.2 à 128K. Pour les gros projets, c’est la différence entre lire un chapitre ou le livre entier.

Quel modèle choisir pour une stratégie de contenu SEO ?

Claude Sonnet 4.6 est mon choix numéro 1 pour la rédaction SEO. Il produit le texte le plus naturel, le mieux structuré, et gère très bien les longues instructions éditoriales. GPT-5.2 est un excellent backup pour les articles très techniques.

GPT-5.2 est-il toujours pertinent face à Claude Sonnet 4.6 ?

Absolument. GPT-5.2 est deuxième en code (74,9% SWE-bench ) et premier en JavaScript/TypeScript/React avec 90-92% de précision. Son écosystème (plugins, batch API, intégrations) reste imbattable. Il n’est pas obsolète, il est spécialisé.

Est-ce que je peux utiliser Gemini 3 Pro gratuitement ?

Gemini 3 Pro a été déployé pour tous les utilisateurs dans l’app Gemini le 11 février 2026, avec des limites supérieures pour les abonnés Google AI Plus, Pro et Ultra. L’accès API est payant.

Ce que j’aurais voulu savoir avant de tester

Trois enseignements de praticien que les reviews classiques ne disent pas :

- Ne cherchez pas le modèle universel. Les écarts de benchmark (4 points entre Claude et Gemini) sont trop faibles pour justifier un choix unique. Le cas d’usage est roi.

- Le coût compte sur la durée. À l’usage intensif, Gemini 3 Pro est 26% moins cher que Claude pour des performances très proches sur le code.

- Le paramètre

effortde Claude Sonnet 4.6 change tout. Mettreeffort: mediumpour les tâches routinières réduit la facture sans sacrifier la qualité. La plupart des utilisateurs ne le savent pas encore.

Vous utilisez lequel des trois au quotidien ? Dites-moi en commentaire — et si vous avez un test précis à proposer, je le fais dans ma prochaine vidéo.

Laisser un commentaire